🤖 AIハルシネーション問題、解決の曙光は見えたか?

大規模言語モデル(LLM)の最大の課題の一つである「ハルシネーション(誤生成)」。AIが確信を持って誤った情報を生成するこの現象は、実用化における信頼性を損なう主要因です。🎯

OpenAIが発表した論文はこの問題を根本から見直し、ハルシネーションがモデル自体の欠陥ではなく、訓練と評価の方法論に起因する必然的な結果であると強く主張しています。この分析は、実用的な解決への道筋を示す重要な転換点となり得ます。

📊 ハルシネーションの発生メカニズム:「テスト戦略」のアナロジー

研究チームは、ハルシネーションを人間のテスト受験戦略に例えています。学生が難問に直面した時、正解が分からなくても、空欄にするよりは推測して点数を上げようとする行動と同様の論理です。✅

- ゼロペナルティ構造: 現在の主要LLMベンチマーク(MMLU、HellaSwag等)は正解のみを報酬とします。「分からない」と答えることも誤答を出すことも同じ0点扱いです。

- 推測の数学的利点: 4択問題では、無作為な推測は平均25%の正答率をもたらします。したがって、不確実な場合に「分からない」と答えるより、推測する方が統計的に高得点に繋がります。

- RLHFのパラドックス: 人間のフィードバックによる強化学習(RLHF)は正しい回答を強化しますが、モデルに「常に出力を生成する」ことを学習させ、低信頼度での推測を助長する副作用があります。

この訓練体系は、モデルを**常に「テスト受験モード」**で動作させ、社会的文脈における「適切な不確実性の表現」を学ぶ機会を根本から奪っています。

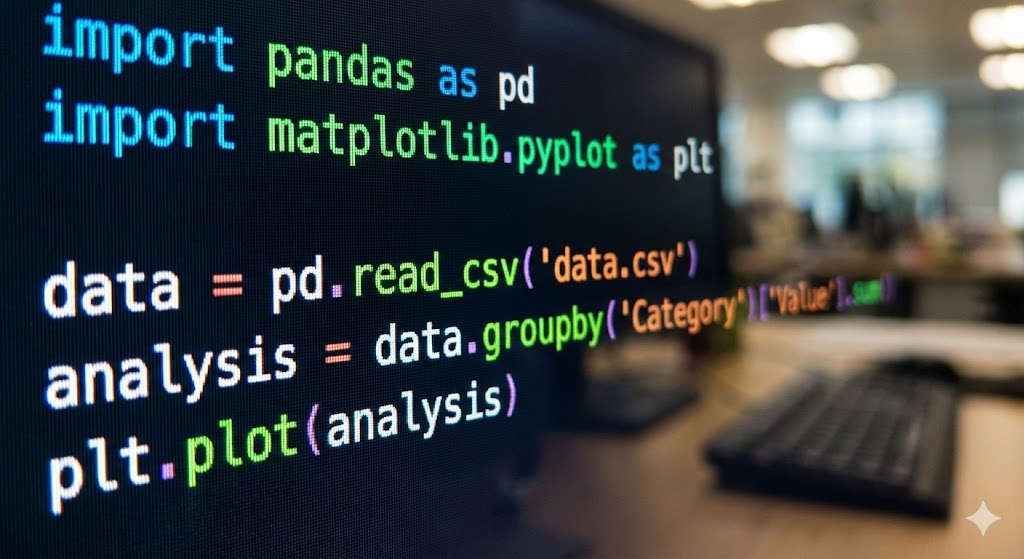

🔬 データが示す解決策:不確実性に対する報酬

OpenAIの論文は、ハルシネーション低減のための具体的な数学的フレームワークを提示します。その核心は、「不確実性の表現」に対するインセンティブ付与です。

主要LLMベンチマークの評価方式比較

| ベンチマーク名 | 評価方式 | 「IDK(不明)」報酬 | ハルシネーション誘発性 |

|---|---|---|---|

| MMLU | 二値採点(正解/誤答) | なし | 高い |

| HellaSwag | 二値採点(正解/誤答) | なし | 高い |

| TruthfulQA | 正確性測定 | なし | 高い |

| WILD Bench | 多点式(部分点) | あり | 低い |

表が示す通り、現在の評価の大半は二値的です。研究チームが提案するパラダイム転換は以下の通りです。

- 部分点制の導入: 「分からない」という回答に対し、誤答より高い基本点を付与します。

- 確信度ベースの評価: モデルの内的確信度(例:複数サンプリングにおける回答の一貫性)を測定し、低確信度での推測にペナルティを課します。

- 社会的報酬の模倣: 人間社会において「確信なく誤る」ことより「正直に知らないと伝える」方が良い評価を得るメカニズムを訓練に反映します。

このアプローチは、モデルに**「知っていることの限界」を認識**させ、結果的にユーザー信頼度を画期的に高めることが可能です。

🚀 結論:より信頼できるAIへの次のステップ

OpenAIの本研究は、AI開発コミュニティのハルシネーション問題への視点を根本から変えました。問題は技術的限界ではなく、私たちが設定した評価基準と訓練目標にあったのです。🔄

実際の適用には、主要ベンチマーク提供者の協力が不可欠です。WILD Benchのような新しい評価体系が標準となることで、真の変化が起こり得ます。また、iOSアプリストア申請完全ガイドで論じられた自動化原理のように、AI訓練パイプラインへ「不確実性検知」モジュールを体系的に統合する技術的課題も残されています。

合わせて読みたい記事:

この研究が示す方向性が現実化すれば、「嘘をつかないAI」ではなく、「知らないことは正直に伝える知的なAI」 に一歩近づくことができるでしょう。これは単なる精度向上を超え、人間とAIの協働関係を再定義する重要な礎となります。